Запустил первый свой сайт

Новому сайт себе во вред творить то, что творят некие товарищи, которым хотя-бы год.

Там и проставление по 1500 ссылок в месяц с мусорных ресурсов - но попутная сему действия реклама в Google Ads. Типа

"у нас есть трафик с платной нерелеватной рекламы гугла а на наши 27К беклинков вы не обращайте внимания".

Некоторые говорят, что можно подняться в топ списка с помощью этого

При тех же вводных данных - сайт новый, мало посетителей и по всем запросам на странице 5-6ой в выдаче?

Наверняка они дают буст уже газующему сайту.

Выслушал бы плавающих в этой сфере людей.

Попробуйте поплавать следующим образом:

1. соберите ключевые фразы, по которым вам нужно быть в топ10

1.1. посетите топ 10-15 сайтов по этим фразам находящихся в Яше и Гусе

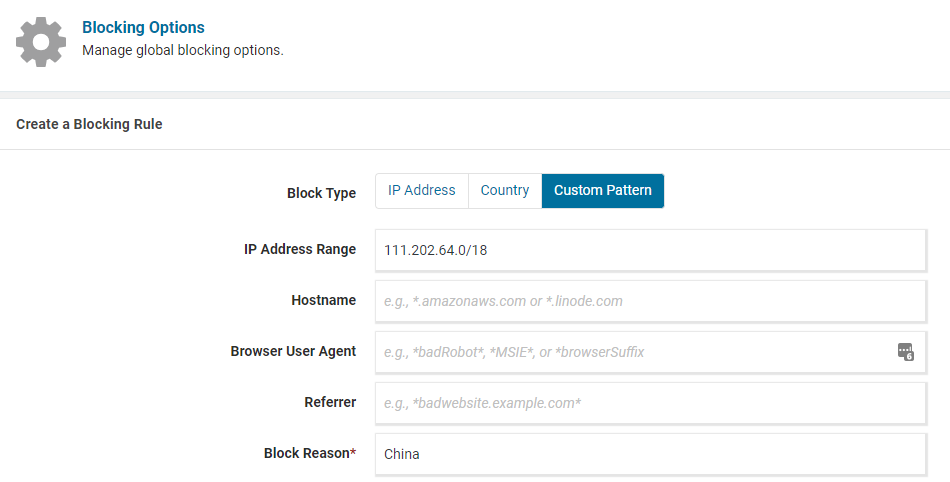

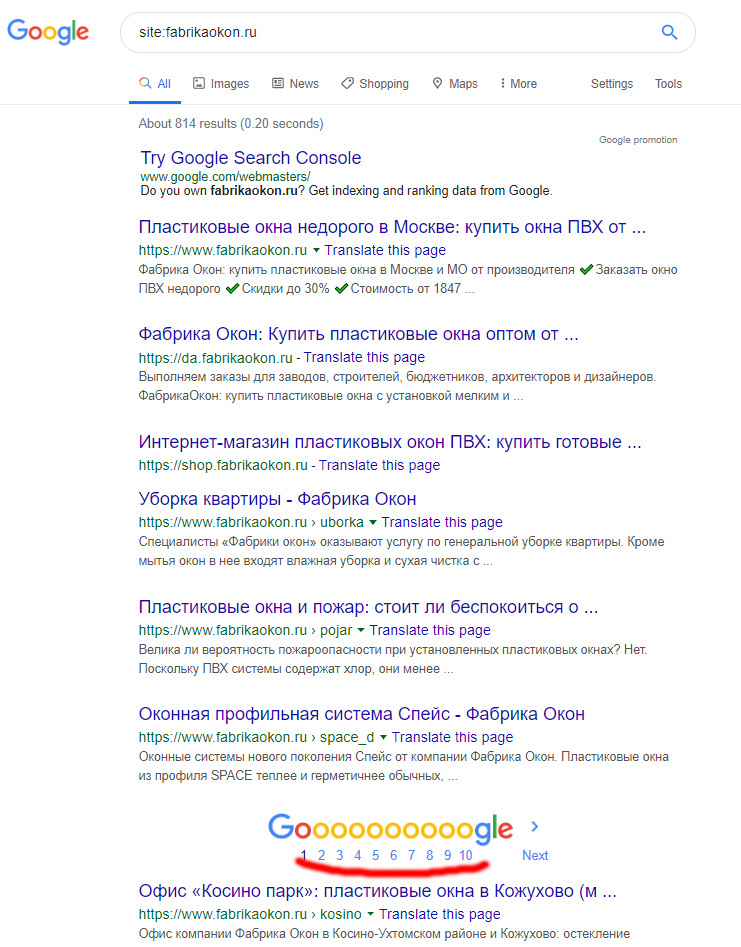

2. пока без инструментов, так сказать голыми руками, введите в строке поиска Гуся site:sitename.com

2.1. получите список на пару страниц или десятков страниц, которые проиндексировал Гусь

2.2. этого вам по хорошему, должно хватит на:

- нарисовать структуру сайта конкурента

- понять что у вас не так или что у вас все совсем не так

- узнать какие ключевые фразы еще существуют и дополнить ваш список в пункте 1

- узнать какие смежные запросы используются для получения трафика

Вообщем, смотря какая ниша - на второй пункт уходит от 1-3 дней до месяца. Пол месяца на осознание и еще пол на применение осознанного.

3. когда вы более-менее поняли "в какую сторону мыло тереть" (Д.Нагиев)

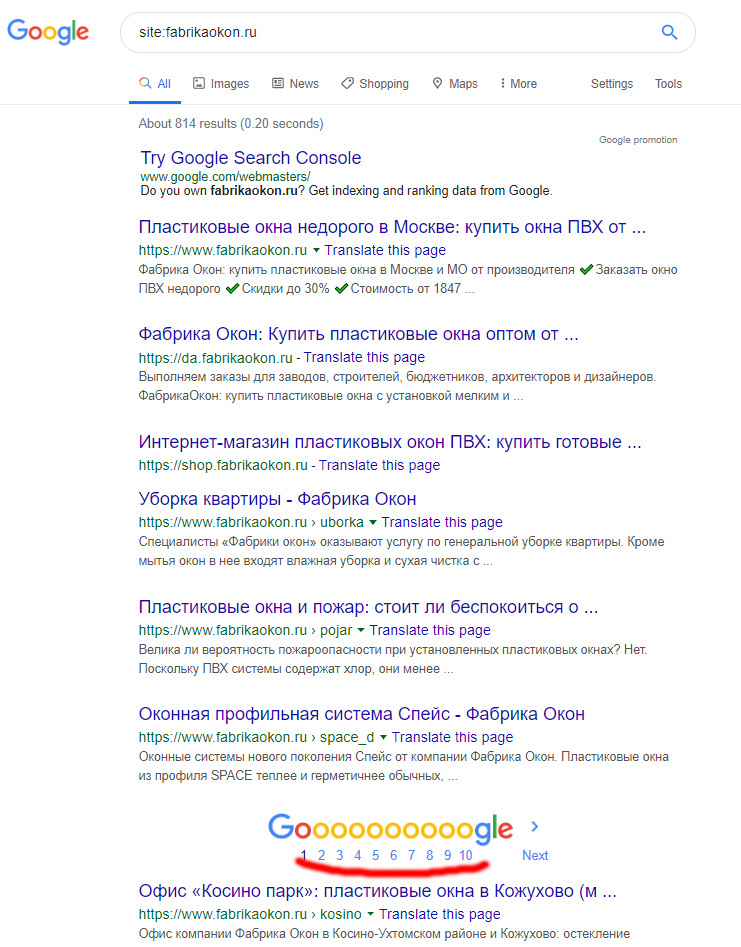

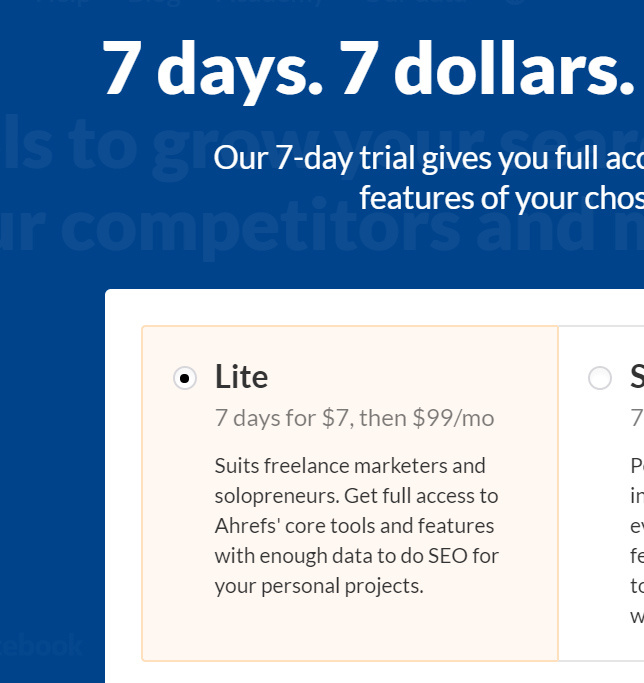

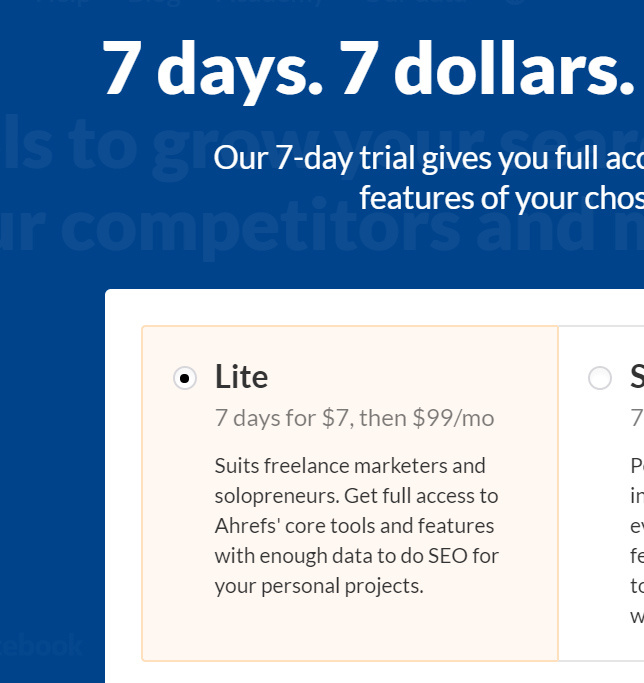

можете прикупить на ahrefs.com лайт за 7баксов.

3.1. не забыть отменить подписку за 7дней дабы не уплатить 179$ буржуйских денег. Либо платить с виртуальной карты, где есть ровно 8денег. Варианты.

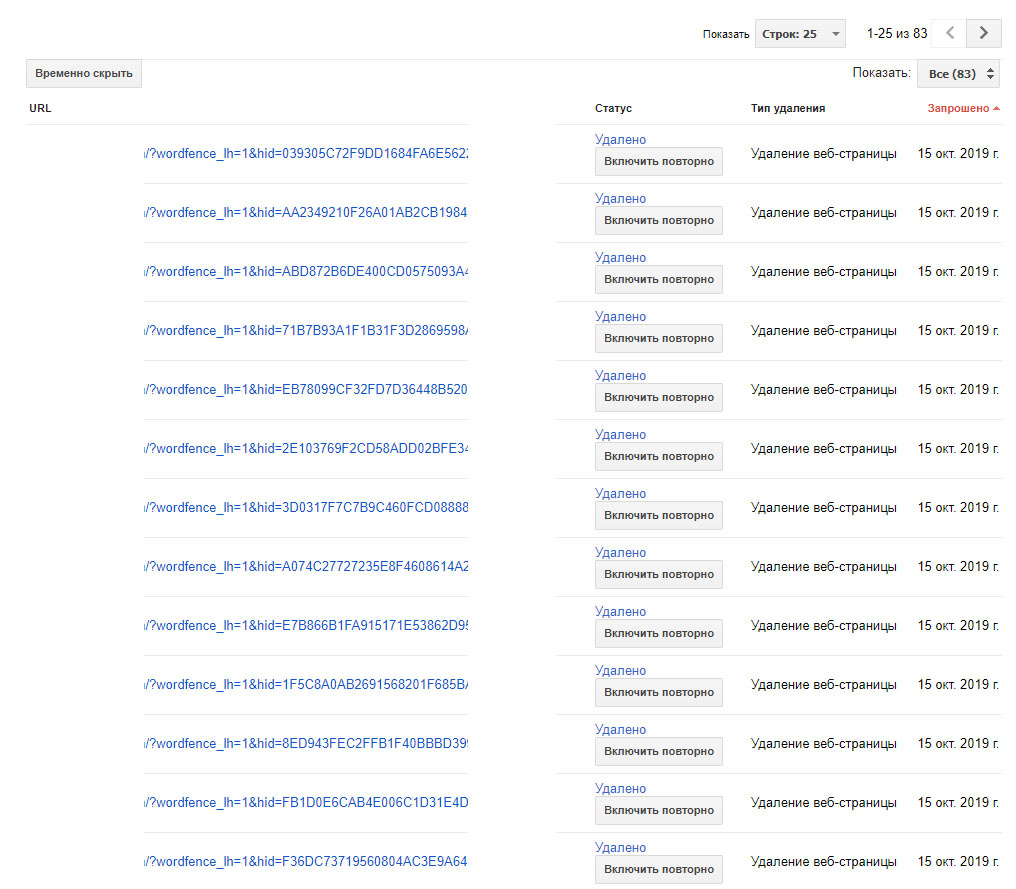

3.2. скормить ахрефсу наиболее интересных конкурентов, снять в экселе обратные ссилки, пойти посмотреть "че как..." Если ресурсы бессплатные, пойти там поставить своих ссылок.

3.3. посмотреть какие запросы принесли сайту наибольший трафик

3.4. переварить

4. воспроизвести подобное на своем сайте

p.s. да, запуск ботов для поднятия поведенческих - это намного проще ;)

успехов!