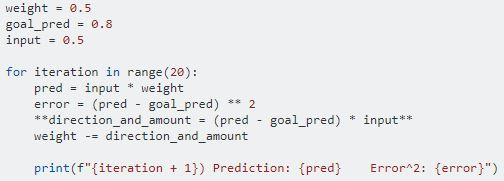

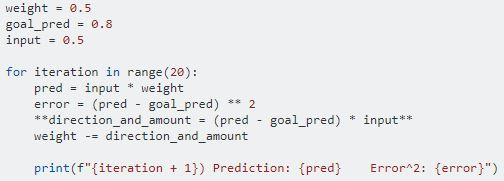

Приведу пример:

Почему в данном примере(при вычислении direction_and_amount) нельзя вместо умножения на input сделать операцию деления? Тогда бы нужный вес нашёлся уже на второй итерации.

Я новичок, поэтому, возможно, вопрос покажется глупым. Прошу строго не судить.