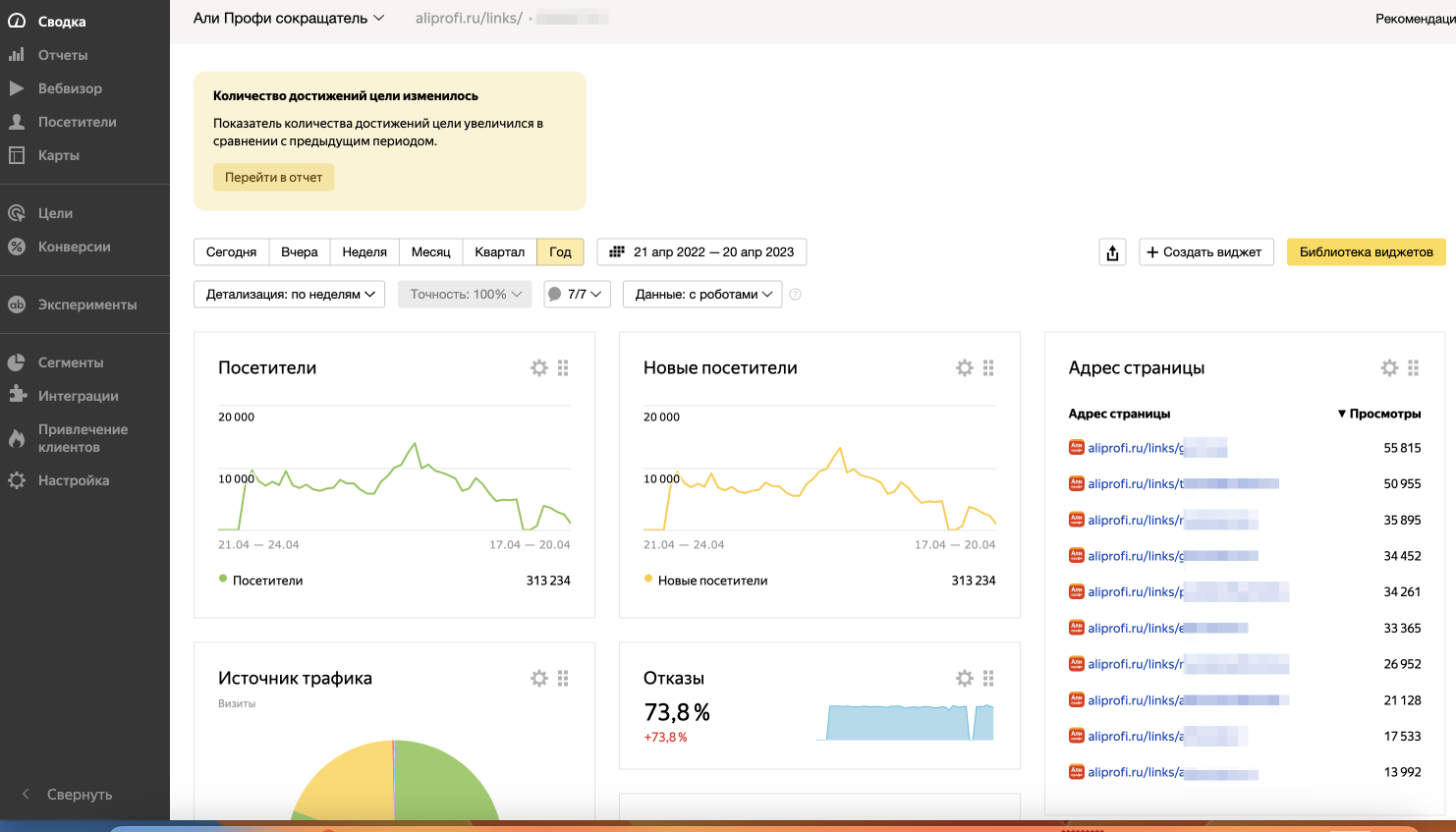

У меня беда с выпадением страниц из индекса началась на сайте

https://aliprofi.ru только в конце 2024 года.

При этом выпадают как станицы с трафиком, так и без. Что делать пока не знаю, вижу вот такие причины, почему это происходит:

1. Страница ранжируется по тем же запросам с другой более мощной страницей. Берем ключ основной и проверяем, если ранжирует и правда другая страница, то переносим текст и делаем редирект.

2. Тонкий контент (мало текста). Дописываем страницу и делаем полезной.

3. Устаревший и, по сути, бесполезный контент. Удаляем страницу или переписываем.

Буду пробовать работать в этом направлении.