Здравствуйте!

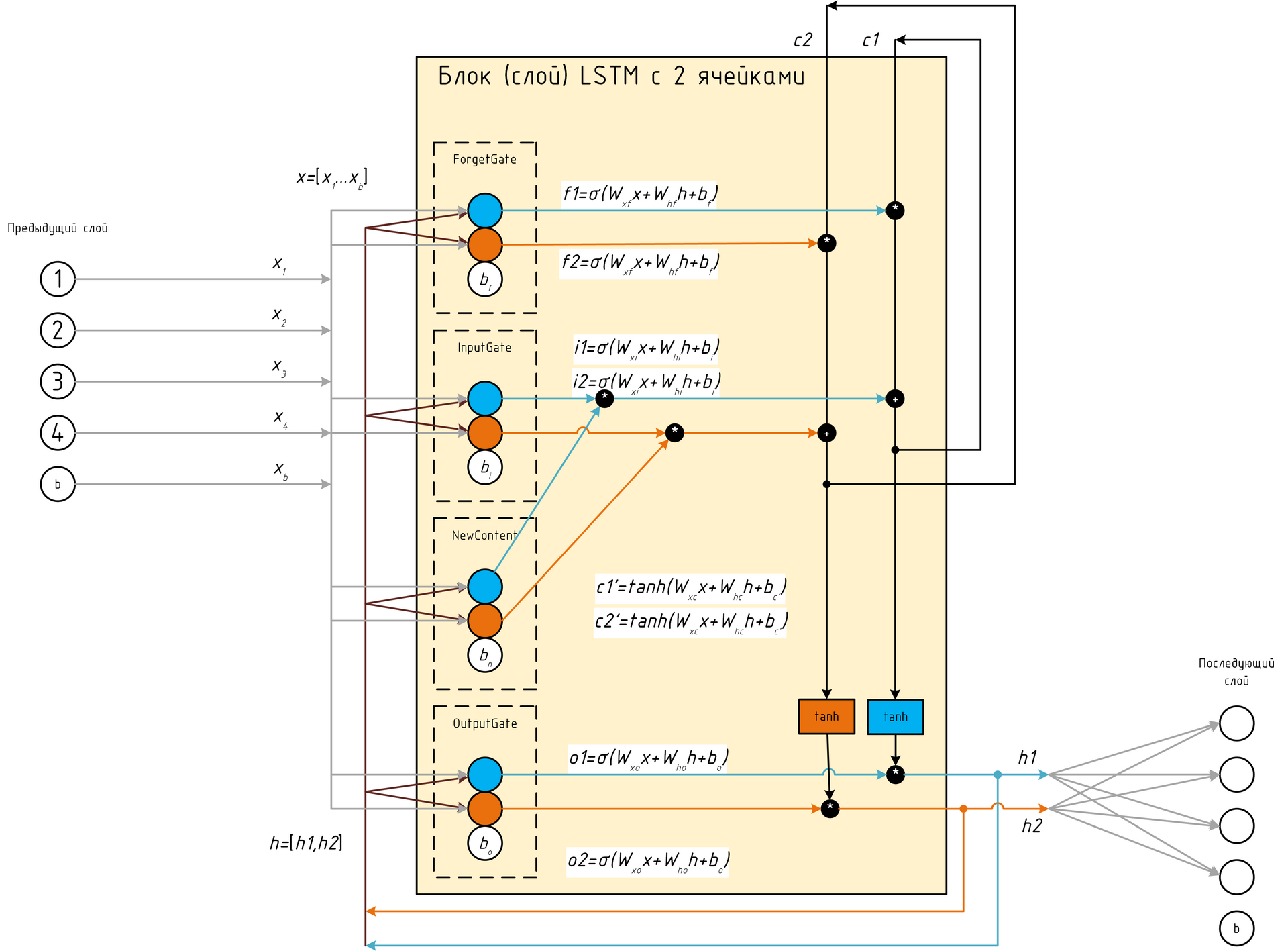

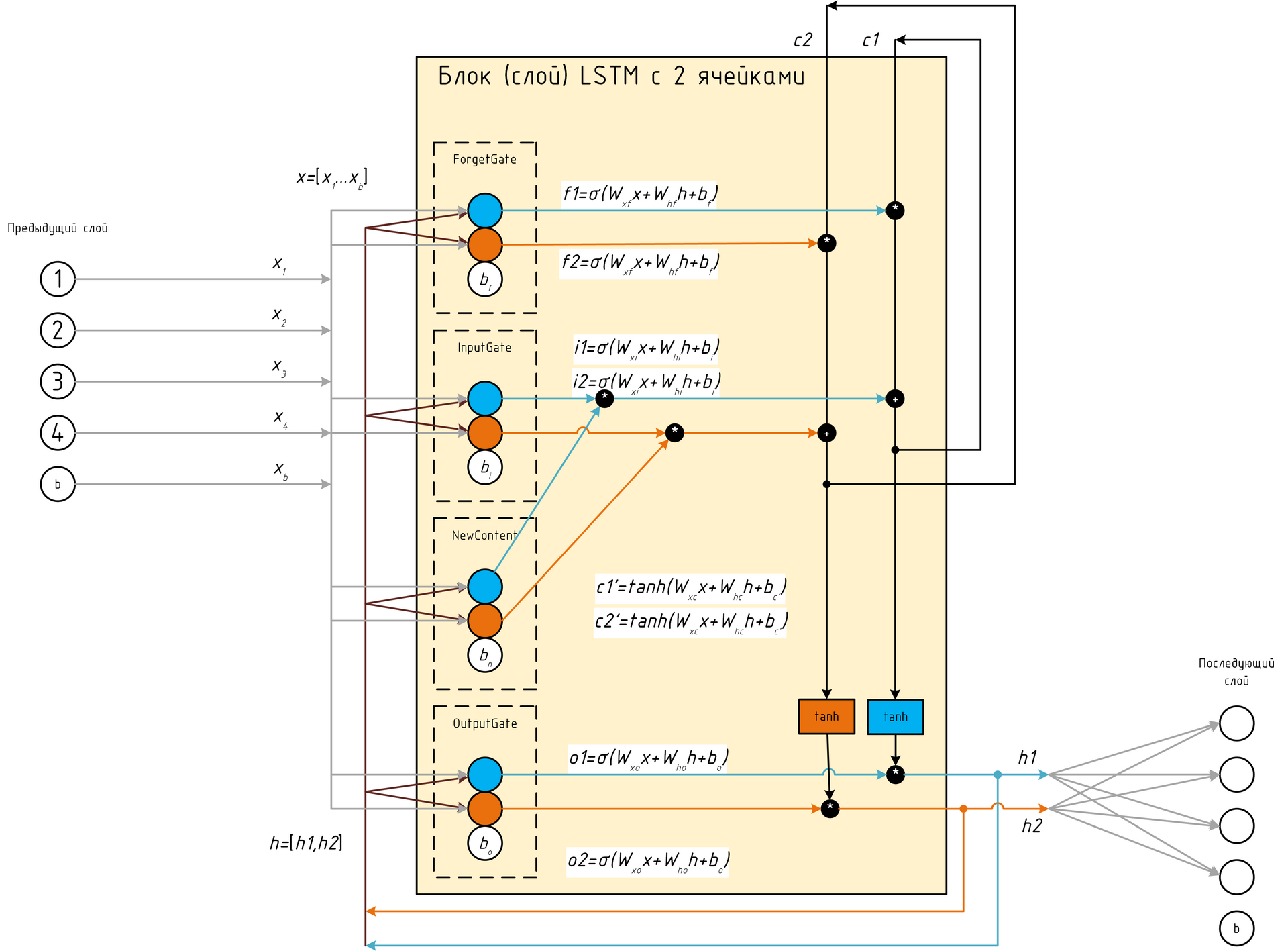

Заинтересовался нейросетями. Пробую реализовать их в коде. С простыми сетями, на основе перцептронов, все ясно. Но столкнулся со сложностями в понимании сетей на основе LSTM. Во всех источниках принцип работы LSTM описан на примере одной ячейки памяти - с пониманием данной темы проблем нет. Но, когда я попробовал собрать блок из нескольких ячеек, то возникли вопросы:

1. Как провести аналогию LSTM ячейки с простым нейроном (перцептроном)? Т.е. если мы создаем слой на основе LSTM, то можем считать ячейку LSTM аналогом простого нейрона в слое простейшей сети? Или аналогом нейрона будет блок из нескольких ячеек LSTM? Или блок LSTM - это уже аналог слоя перцептронов?

2. Biass нейрон в гейтах LSTM - данный нейрон общий для конкретного гейта всех ячеек или в каждой ячейке свой? Поясню, пусть у нас две ячейки, тогда в InputGate будет два biass нейрона (по одному на ячейку) или один?

Свое понимание изобразил на рис.

Верно/не верно?