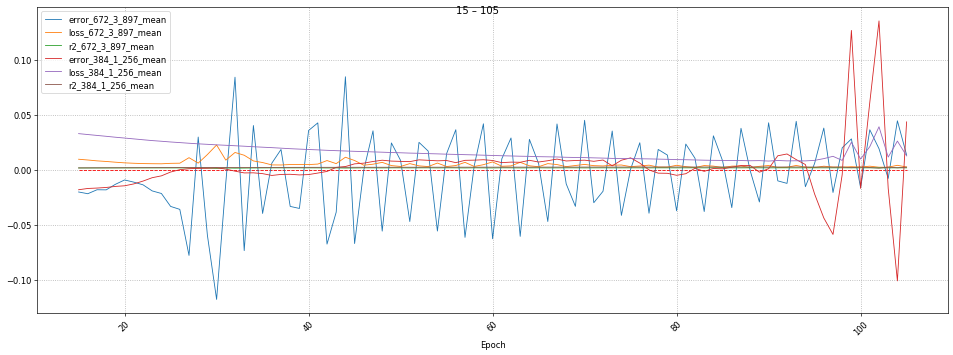

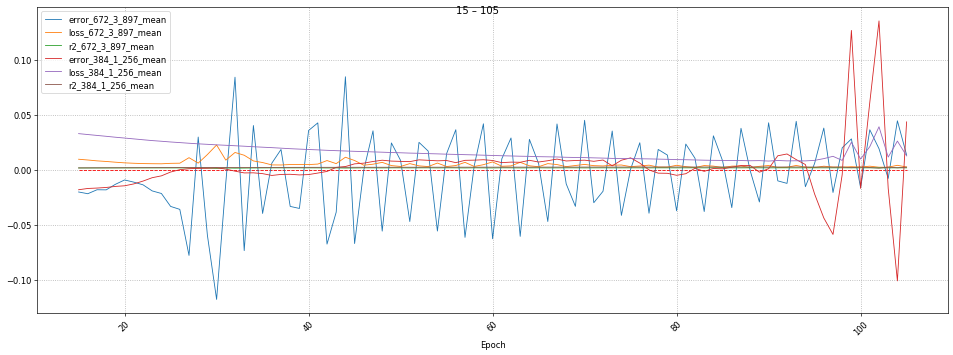

Тестировал нейросеть с различными параметрами модели: количество full-connected слоев, их размер, размер пакета обучения. Валидацию сеть проводит по Loss, который уменьшался, но ошибка стала колебаться с возрастанием амплитуды колебаний.

Отсюда, 2 вопроса:

- Нормально ли явление "скачущей ошибки" от плюса к минусу при обучении?

- Правильно ли я понимаю что в итоге, ошибка должна получиться положительная?